Estratégias práticas para revisar rascunhos sintéticos, eliminar vícios de linguagem e garantir precisão factual alinhada às diretrizes do Google.

O uso de grandes modelos de linguagem (LLMs) acelerou drasticamente a produção de conteúdo, mas trouxe um efeito colateral que exige atenção redobrada dos editores: a proliferação de textos genéricos e factualmente incorretos. Durante testes rotineiros de geração de artigos técnicos, é bastante comum notar a inteligência artificial inventando ferramentas, como um suposto software chamado “Arobid 2.0”, ou afirmando equivocadamente que já estamos em anos futuros, como 2026.

Esses equívocos não são meros erros de digitação. Eles representam uma característica inerente à arquitetura dessas tecnologias e exigem um processo editorial rigoroso para que o conteúdo final seja útil e confiável para o leitor.

Por que os modelos de linguagem inventam fatos

Sistemas baseados em inteligência artificial generativa operam prevendo a próxima palavra com base em padrões estatísticos de seus dados de treinamento, e não consultando um banco de dados de verdades absolutas. Esse comportamento resulta no que pesquisadores chamam de “alucinações”.

Um estudo contínuo mantido pela plataforma Vectara, o *Hallucination Leaderboard*, que avalia a precisão de diversos LLMs do mercado, aponta que as taxas de alucinação podem variar de 3% a mais de 27%, dependendo do modelo utilizado e da complexidade da tarefa. Na prática, se um redator pede para a IA escrever sobre uma tecnologia emergente ou um evento recente sem fornecer um contexto estrito, o sistema preencherá as lacunas com informações que soam plausíveis, porém são inteiramente falsas.

Tratar a inteligência artificial como um motor de busca é um erro metodológico. A ferramenta atua bem na estruturação de ideias, mas falha na validação da realidade.

O impacto dos clichês na percepção de qualidade

Além das falhas factuais, a baixa qualidade textual é um sintoma claro de conteúdo sintético que não passou por curadoria humana. A linguagem gerada por algoritmos tende a convergir para a média, resultando em um tom excessivamente formal ou repleto de frases feitas.

Em fluxos de revisão editorial, identificamos padrões repetitivos. A IA adota frequentemente expressões introdutórias vazias, abusa de adjetivos e utiliza construções que enfraquecem a autoridade do texto. O resultado é um material prolixo, que demora a entregar valor direto ao leitor.

Textos de alto nível exigem concisão e vocabulário preciso. A remoção dessas repetições desnecessárias e a substituição de jargões vazios por informações objetivas são ações fundamentais para reter a atenção de um público exigente. Um conteúdo de qualidade deve ir direto ao ponto, respeitando o tempo de quem o consome.

Estratégias para aplicar experiência e autoridade

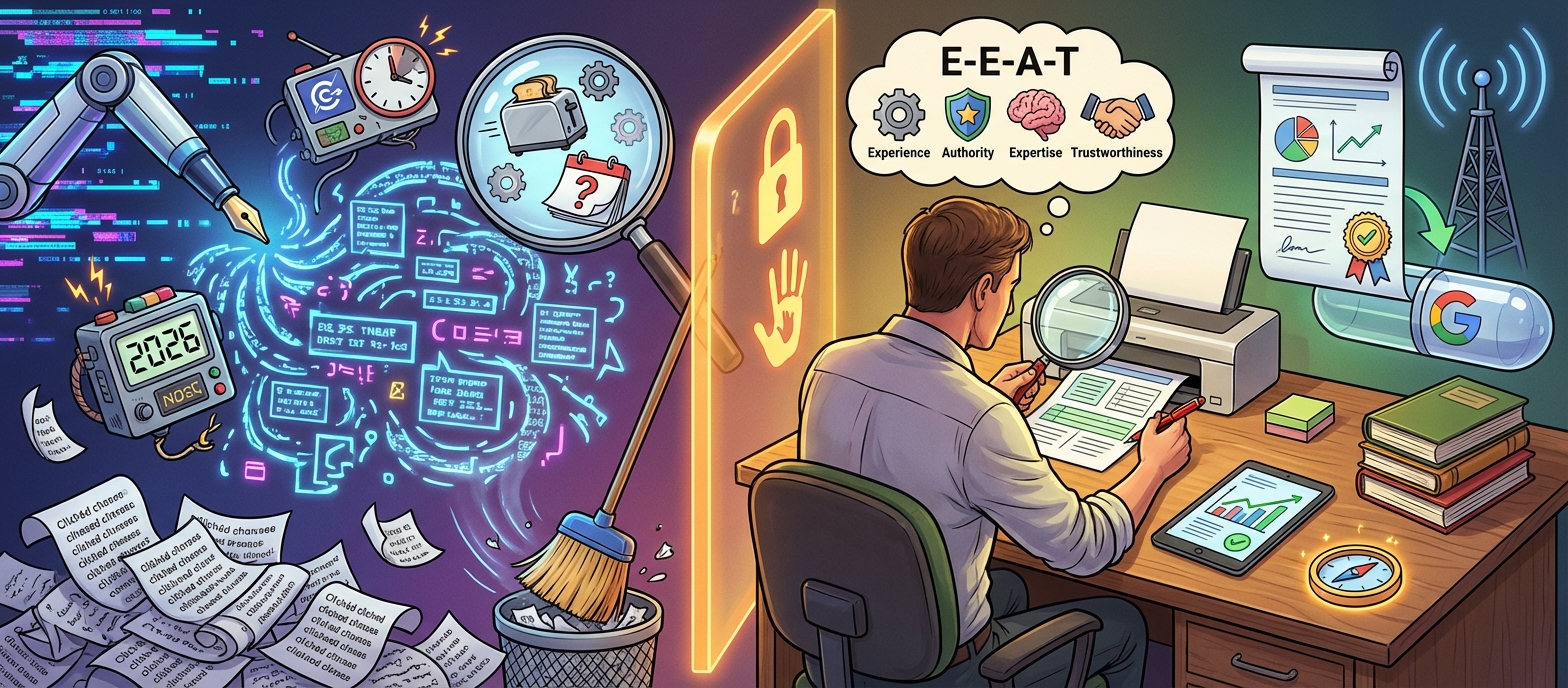

Para transformar um rascunho de IA em um material confiável, é necessário ancorar o texto na realidade prática. O Google, em sua documentação oficial sobre conteúdo gerado por IA, enfatiza que o foco dos algoritmos de busca está na qualidade final do material e na aplicação dos princípios de E-E-A-T (Experiência, Especialidade, Autoridade e Confiabilidade).

A maneira mais eficaz de demonstrar esses princípios é inserindo observações de uso de primeira mão e limitações reais no texto. Se o artigo aborda um novo software de gestão corporativa, em vez de permitir que a IA liste benefícios abstratos, o editor deve adicionar parágrafos sobre como a interface se comportou durante a integração com o sistema de CRM da empresa.

Relatar dificuldades reais enfrentadas por uma equipe, descrever gargalos de usabilidade ou comparar o tempo de resposta do suporte técnico são detalhes práticos impossíveis de serem fabricados com autenticidade por um algoritmo. São essas nuances que sinalizam ao leitor que há um profissional experiente por trás da publicação.

O processo rigoroso de checagem de dados

A etapa final da edição deve tratar o texto sintético como uma fonte primária não confiável que necessita de auditoria completa. Qualquer estatística, data, nome de empresa ou citação gerada precisa ser cruzada com fontes oficiais.

Se a ferramenta afirmar que uma nova métrica de SEO passou a ser utilizada pelo mercado, busque a documentação original dos desenvolvedores ou estudos de caso de agências reconhecidas. Se não for possível encontrar uma fonte verificável que embase a afirmação, a regra editorial deve ser rigorosa: remova o dado ou reescreva o trecho focando apenas na explicação do conceito.

Manter a precisão terminológica e a integridade factual não é apenas uma questão de estilo, mas de sobrevivência digital. Publicar conteúdos alucinados destrói a confiança do público e expõe o portal a penalizações severas por disseminar desinformação. A inteligência artificial é um excelente assistente de rascunhos, mas a responsabilidade pela verdade continua sendo, exclusivamente, humana.